Tổng hợp: 40 thuật ngữ Trí tuệ nhân tạo tạo sinh (Generative AI) cần biết

Published on: October 01, 2024

Last updated: March 27, 2026 Xem trên toàn màn hình

Last updated: March 27, 2026 Xem trên toàn màn hình

- 01 Nov 2021

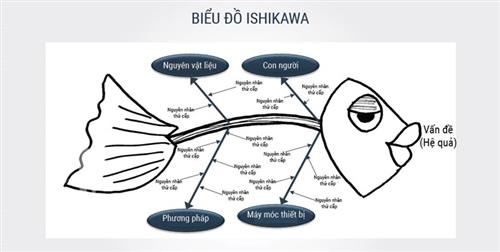

Phân tích quy trình hiện tại (AS-IS) là gì? 212/1134

Phân tích quy trình hiện tại (AS-IS) là gì? 212/1134 - 01 Sep 2022

Thiên kiến xác nhận (Confirmation Bias) có phải là một dạng bảo thủ? 121/896

Thiên kiến xác nhận (Confirmation Bias) có phải là một dạng bảo thủ? 121/896 - 19 Aug 2025

Lập dự toán chi phí và thời gian cho dự án Software Outsourcing Project 92/149

Lập dự toán chi phí và thời gian cho dự án Software Outsourcing Project 92/149 - 21 Jan 2022

SSO (Single Sign On) là gì? Bạn đã hiểu đúng và đẩy đủ vè chìa khóa thông minh SSO? 88/521

SSO (Single Sign On) là gì? Bạn đã hiểu đúng và đẩy đủ vè chìa khóa thông minh SSO? 88/521 - 12 Nov 2024

"Nhân tình thế thái" là gì? "Thời thế" là gì? 83/1858

"Nhân tình thế thái" là gì? "Thời thế" là gì? 83/1858 - 08 Feb 2021

Quy trình nâng cấp phần mềm quản trị doanh nghiệp ERP 82/324

Quy trình nâng cấp phần mềm quản trị doanh nghiệp ERP 82/324 - 05 Jan 2024

Value-Added Distributors (VAD) là gì? 79/916

Value-Added Distributors (VAD) là gì? 79/916 - 01 Nov 2023

Lệnh thay đổi kỹ thuật (Engineering Change Order - ECO) là gì? 77/1626

Lệnh thay đổi kỹ thuật (Engineering Change Order - ECO) là gì? 77/1626 - 05 Mar 2024

[Học tiếng Anh] "Go with caveats" là gì? 75/415

[Học tiếng Anh] "Go with caveats" là gì? 75/415 - 01 Sep 2023

"Data steward" là gì? 73/577

"Data steward" là gì? 73/577 - 12 Nov 2024

Retrieval-Augmented Generation (RAG) là gì? 69/89

Retrieval-Augmented Generation (RAG) là gì? 69/89 - 03 Nov 2022

BAU (Business-As-Usual) là gì? 68/2020

BAU (Business-As-Usual) là gì? 68/2020 - 09 Jan 2024

Domain Knowledge là gì? Ưu và nhược điểm? 66/790

Domain Knowledge là gì? Ưu và nhược điểm? 66/790 - 24 Jun 2024

Apache Pulsar là gì? 65/740

Apache Pulsar là gì? 65/740 - 19 Aug 2024

Kiểm toán công nghệ thông tin (IT Audit) - Nghề mới mẻ ở Việt Nam 64/602

Kiểm toán công nghệ thông tin (IT Audit) - Nghề mới mẻ ở Việt Nam 64/602 - 09 Dec 2023

Phần mềm Best-of-class là gì? 63/306

Phần mềm Best-of-class là gì? 63/306 - 08 Aug 2019

10 lý do tại sao việc sử dụng và vận hành phần mềm điều hành doanh nghiệp không được hiệu quả 63/218

10 lý do tại sao việc sử dụng và vận hành phần mềm điều hành doanh nghiệp không được hiệu quả 63/218 - 26 Jul 2024

"Khổ tận cam lai" - Làm thế nào để chuyển hóa từ khổ thành sướng? 62/2725

"Khổ tận cam lai" - Làm thế nào để chuyển hóa từ khổ thành sướng? 62/2725 - 01 Jan 2024

Phân tích tổ hợp (Cohort Analysis) là gì? 61/584

Phân tích tổ hợp (Cohort Analysis) là gì? 61/584 - 08 Dec 2023

Giải mã bí mật của trò chơi vô hạn và hữu hạn 58/499

Giải mã bí mật của trò chơi vô hạn và hữu hạn 58/499 - 08 Apr 2024

Hiệu ứng Matthew: Tác động và Ứng dụng trong Chuyển đổi Số và Công nghệ tại Việt Nam 58/267

Hiệu ứng Matthew: Tác động và Ứng dụng trong Chuyển đổi Số và Công nghệ tại Việt Nam 58/267 - 05 Aug 2024

Giải mã 10 sai lầm về quản lý thay đổi 57/468

Giải mã 10 sai lầm về quản lý thay đổi 57/468 - 08 Dec 2023

Hiệu ứng Barnum là gì? Hiệu ứng Barnum tốt hay xấu? 53/514

Hiệu ứng Barnum là gì? Hiệu ứng Barnum tốt hay xấu? 53/514 - 23 Aug 2024

Nghịch lý toán học chứng minh giới hạn của AI 52/351

Nghịch lý toán học chứng minh giới hạn của AI 52/351 - 04 May 2024

Hiệu ứng FOMO trong phát triển phần mềm 52/428

Hiệu ứng FOMO trong phát triển phần mềm 52/428 - 19 Jun 2024

Giải mã AI, ML và DL: Chìa khóa nắm bắt xu hướng chuyển đổi số 52/249

Giải mã AI, ML và DL: Chìa khóa nắm bắt xu hướng chuyển đổi số 52/249 - 28 Dec 2023

"Watered-down version" và "Stripped-down version" là gì? 52/630

"Watered-down version" và "Stripped-down version" là gì? 52/630 - 01 Dec 2022

Business Critical là gì? 51/696

Business Critical là gì? 51/696 - 24 Mar 2023

Mô hình kinh doanh Open-Core là gì? 51/248

Mô hình kinh doanh Open-Core là gì? 51/248 - 08 Dec 2022

Phân biệt Cookbook, In a nutshell và Dummies 50/490

Phân biệt Cookbook, In a nutshell và Dummies 50/490 - 02 Aug 2025

Cloud vs On-Premise vs Hybrid: Lựa chọn nào phù hợp nhất cho vận hành phần mềm doanh nghiệp? 50/154

Cloud vs On-Premise vs Hybrid: Lựa chọn nào phù hợp nhất cho vận hành phần mềm doanh nghiệp? 50/154 - 26 Mar 2025

Từ điển tất cả các chức danh trong lĩnh vực CNTT và Chuyển Đổi Số 48/133

Từ điển tất cả các chức danh trong lĩnh vực CNTT và Chuyển Đổi Số 48/133 - 02 Jan 2024

Domain Engineering là gì? 48/542

Domain Engineering là gì? 48/542 - 06 Dec 2023

Loại phần mềm "fire-and-forget" là gì? 48/396

Loại phần mềm "fire-and-forget" là gì? 48/396 - 08 Dec 2023

Resource Leveling là gì? 48/457

Resource Leveling là gì? 48/457 - 02 Jan 2024

Domain Engineering là gì? 48/542

Domain Engineering là gì? 48/542 - 07 Aug 2024

Top 15 Kỹ Thuật Tối Ưu Khi Sử Dụng ChatGPT 48/224

Top 15 Kỹ Thuật Tối Ưu Khi Sử Dụng ChatGPT 48/224 - 01 Aug 2022

Đỉnh cao ứng xử của kẻ trí tuệ: Nhìn thấu không nói, biết người không bình, hiểu lý không tranh 48/462

Đỉnh cao ứng xử của kẻ trí tuệ: Nhìn thấu không nói, biết người không bình, hiểu lý không tranh 48/462 - 04 Oct 2023

Authority bias (Thiên kiến uy quyền) là gì? 46/682

Authority bias (Thiên kiến uy quyền) là gì? 46/682 - 14 Aug 2025

Văn bản do AI tạo ra có cấu trúc khác với văn bản con người tạo ra như thế nào? 46/91

Văn bản do AI tạo ra có cấu trúc khác với văn bản con người tạo ra như thế nào? 46/91 - 18 Jul 2024

Các chuyên gia tư vấn sử dụng các thuật ngữ Lean & Agile trong các dự án thực tế như thế nào? 45/103

Các chuyên gia tư vấn sử dụng các thuật ngữ Lean & Agile trong các dự án thực tế như thế nào? 45/103 - 04 Sep 2020

IQ, EQ hay LQ quan trọng nhất trong thời đại 4.0? 44/627

IQ, EQ hay LQ quan trọng nhất trong thời đại 4.0? 44/627 - 01 Aug 2024

Infomercial - Chiến thuật "cô đọng" điều gì đó trong đầu người dùng 44/478

Infomercial - Chiến thuật "cô đọng" điều gì đó trong đầu người dùng 44/478 - 01 Dec 2023

Microsoft Power Apps là gì? 44/317

Microsoft Power Apps là gì? 44/317 - 22 Nov 2023

Phân biệt tư duy hệ thống khác với tư duy thiết kế 44/472

Phân biệt tư duy hệ thống khác với tư duy thiết kế 44/472 - 08 Oct 2024

Giải thích 25 thuật ngữ Data Science theo cách dễ hiểu cho người ngoại đạo 42/247

Giải thích 25 thuật ngữ Data Science theo cách dễ hiểu cho người ngoại đạo 42/247 - 01 Mar 2024

Google thử nghiệm Search AI (Search Generative Experience - SGE) 41/424

Google thử nghiệm Search AI (Search Generative Experience - SGE) 41/424 - 27 Mar 2024

Chuyên viên Tư vấn SAP FI/CO là nghề gì? 40/48

Chuyên viên Tư vấn SAP FI/CO là nghề gì? 40/48 - 01 May 2024

Tổng hợp các thuật ngữ lĩnh vực tư vấn CNTT 39/108

Tổng hợp các thuật ngữ lĩnh vực tư vấn CNTT 39/108 - 09 Apr 2025

10 bẫy thao túng bạn có thể chưa biết 38/162

10 bẫy thao túng bạn có thể chưa biết 38/162 - 11 Dec 2022

Sustaining Engineering là gì? 38/422

Sustaining Engineering là gì? 38/422 - 04 Jan 2023

Enterprise Forms Automation là gì? Vì Sao Tự Động Hóa Biểu Mẫu Trở Thành Lựa Chọn Tất Yếu? 37/66

Enterprise Forms Automation là gì? Vì Sao Tự Động Hóa Biểu Mẫu Trở Thành Lựa Chọn Tất Yếu? 37/66 - 09 Mar 2025

'Vibe Coding': Sự Kết Thúc Của Lập Trình Truyền Thống? 36/554

'Vibe Coding': Sự Kết Thúc Của Lập Trình Truyền Thống? 36/554 - 01 Nov 2022

MVF (Minimum Viable Features): Tối ưu tính năng trong giới hạn nguồn lực 34/118

MVF (Minimum Viable Features): Tối ưu tính năng trong giới hạn nguồn lực 34/118 - 02 Aug 2024

Tổng hợp các câu nói động lực - chất xúc tác cho sự phát triển bản thân 33/163

Tổng hợp các câu nói động lực - chất xúc tác cho sự phát triển bản thân 33/163 - 19 Jan 2025

AI Agents: Ngọn Hải Đăng Dẫn Lối Khởi Nghiệp Trong Kỷ Nguyên Số 33/210

AI Agents: Ngọn Hải Đăng Dẫn Lối Khởi Nghiệp Trong Kỷ Nguyên Số 33/210 - 27 Nov 2024

Ứng dụng AI theo dõi thu chi gây sốt vì 'mắng' người tiêu tiền 33/181

Ứng dụng AI theo dõi thu chi gây sốt vì 'mắng' người tiêu tiền 33/181 - 07 Feb 2025

Buyer’s remorse: Sự hối hận của người mua sau khi chốt đơn mua hàng 32/185

Buyer’s remorse: Sự hối hận của người mua sau khi chốt đơn mua hàng 32/185 - 02 Nov 2023

"State-of-the-art product" là gì? 32/337

"State-of-the-art product" là gì? 32/337 - 02 Aug 2022

BVP (Billable Viable Product) là gì? 30/121

BVP (Billable Viable Product) là gì? 30/121 - 01 Sep 2025

AI đang thay đổi khoa học quản trị hiện đại như thế nào 30/83

AI đang thay đổi khoa học quản trị hiện đại như thế nào 30/83 - 01 Nov 2022

Like for like là gì 28/598

Like for like là gì 28/598 - 07 Dec 2022

Lean Software Development là gì? 28/365

Lean Software Development là gì? 28/365 - 01 Nov 2021

Knowldge Base là gì? 27/215

Knowldge Base là gì? 27/215 - 21 Mar 2024

12 triết lý sống tối giản bạn nên biết 27/171

12 triết lý sống tối giản bạn nên biết 27/171 - 28 Nov 2025

AI có thể chống lại “tư duy bầy đàn” trong doanh nghiệp? 24/58

AI có thể chống lại “tư duy bầy đàn” trong doanh nghiệp? 24/58 - 03 May 2024

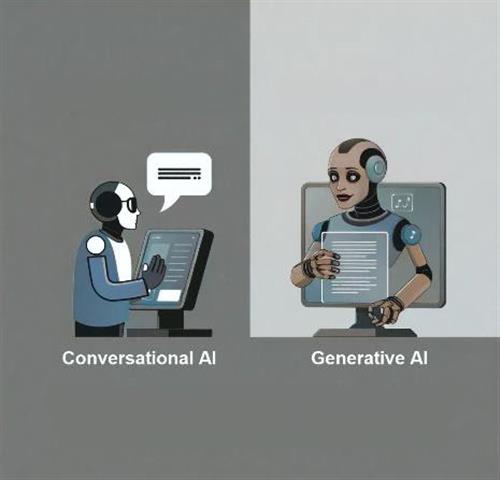

AI Đàm Thoại (Conversational AI) – Cuộc Cách Mạng Công Nghệ Đầy Hứa Hẹn 24/198

AI Đàm Thoại (Conversational AI) – Cuộc Cách Mạng Công Nghệ Đầy Hứa Hẹn 24/198 - 23 Apr 2025

Multimodal Agent AI – Cuộc cách mạng trong tương tác người – máy 22/169

Multimodal Agent AI – Cuộc cách mạng trong tương tác người – máy 22/169 - 02 Jul 2025

Doanh nghiệp đối diện CHI PHÍ ẨN khi không áp dụng "AI Agents": Lộ diện nguy cơ tụt hậu 20/94

Doanh nghiệp đối diện CHI PHÍ ẨN khi không áp dụng "AI Agents": Lộ diện nguy cơ tụt hậu 20/94

- Generative AI: AI tạo sinh, tạo ra dữ liệu mới, thường được sử dụng trong các tác vụ như tạo văn bản hoặc tổng hợp hình ảnh.

- Discriminative AI: AI phân biệt, tập trung vào việc phân loại giữa các danh mục khác nhau dựa trên dữ liệu đầu vào.

- AGI (Artificial General Intelligence): Trí tuệ nhân tạo tổng quát, nhằm tạo ra máy móc có khả năng học tập và suy luận như con người trong nhiều tác vụ khác nhau.

- ASI (Artificial Super Intelligence): Trí tuệ nhân tạo siêu việt, một khái niệm lý thuyết về AI vượt trội hơn trí thông minh của con người trong mọi khả năng.

- ANI (Artificial Narrow Intelligence): Trí tuệ nhân tạo hẹp, chuyên biệt trong việc thực hiện một tập hợp các tác vụ cụ thể, thiếu trí thông minh tổng quát của con người.

- Foundation LLM: Mô hình ngôn ngữ lớn nền tảng, được thiết kế để tạo ra và hiểu văn bản giống con người trong nhiều trường hợp sử dụng khác nhau.

- Self-Supervision: Tự giám sát, phương pháp huấn luyện mà mô hình học từ dữ liệu không có nhãn rõ ràng, thường bằng cách dự đoán các phần ẩn của đầu vào.

- Domain Adaptation: Thích ứng miền, điều chỉnh một mô hình đã được huấn luyện trên một miền để hoạt động tốt trong một miền khác nhưng có liên quan.

- Context Length: Độ dài ngữ cảnh, số lượng từ/token đầu vào tối đa mà một mô hình có thể xem xét khi tạo ra đầu ra.

- Zero Shot Learning: Học không mẫu, chỉ cung cấp hướng dẫn nhiệm vụ cho mô hình, dựa hoàn toàn vào kiến thức sẵn có của nó.

- Few Shot Learning: Học ít mẫu, cung cấp rất ít ví dụ cho mô hình để hỗ trợ nó thực hiện một nhiệm vụ cụ thể.

- Transformer: Kiến trúc mô hình phổ biến trong LLM, nổi tiếng với cơ chế chú ý (attention) và khả năng xử lý song song.

- Attention: Cơ chế chú ý, phổ biến trong mạng nơ-ron cho phép tập trung vào các phần cụ thể của dữ liệu đầu vào.

- Weights: Trọng số, tham số nội tại của mô hình quyết định cách nó xử lý và tạo ra văn bản.

- MM-LLM: Mô hình ngôn ngữ lớn đa phương thức (multi modal), có khả năng hiểu và tạo ra nội dung trên nhiều phương thức như hình ảnh và âm thanh cùng với văn bản.

- Diffusion Models: Mô hình khuếch tán, tạo ra dữ liệu bằng cách tinh chỉnh lặp đi lặp lại một tín hiệu nhiễu, thường được sử dụng trong tạo hình ảnh.

- RAG (Retrieval-Augmented Generation): Tạo sinh tăng cường truy xuất, bổ sung thông tin được truy xuất để cải thiện sự chính xác trong phản hồi của mô hình.

- Tokenization: Phân mảnh, quá trình chia nhỏ văn bản thành các đơn vị nhỏ hơn (token), thường được sử dụng làm đầu vào cho LLM.

- Knowledge Base: Cơ sở kiến thức, tập hợp các tài liệu từ đó thông tin liên quan được truy xuất trong RAG.

- Structured Data: Dữ liệu có cấu trúc, được tổ chức theo định dạng được xác định trước với mối quan hệ rõ ràng giữa các phần tử khác nhau, như bảng hoặc cơ sở dữ liệu.

- Unstructured Data: Dữ liệu phi cấu trúc, thiếu định dạng hoặc tổ chức được xác định trước, như văn bản ngôn ngữ tự nhiên hoặc hình ảnh.

- Vector DB: Cơ sở dữ liệu vector, được tối ưu hóa để lưu trữ và truy xuất các biểu diễn vector được tạo ra từ cơ sở kiến thức.

- Embeddings: Nhúng, một định dạng số được sử dụng để biểu diễn các đặc trưng dữ liệu. Còn được gọi là vector.

- Vector Search: Tìm kiếm vector, tìm các phần liên quan nhất của cơ sở kiến thức dựa trên điểm tương đồng vector cho một truy vấn đầu vào cụ thể.

- Prompting: Gợi ý, cung cấp đầu vào được thiết kế cẩn thận cho LLM để tạo ra đầu ra mong muốn.

- User Prompt: Gợi ý người dùng, truy vấn do người dùng cung cấp để tương tác với LLM, chỉ định nhiệm vụ, câu hỏi hoặc ngữ cảnh mong muốn.

- System Prompt: Gợi ý hệ thống, đầu vào ban đầu được đưa ra cho LLM để xác định nhiệm vụ, thường giữ nguyên trong nhiều gợi ý người dùng.

- Meta Prompting: Gợi ý meta, yêu cầu LLM tạo ra gợi ý tối ưu cho nhiệm vụ dự định của bạn.

- In-Context Learning: Học trong ngữ cảnh, tích hợp các ví dụ nhiệm vụ vào gợi ý, cho phép LLM xử lý các nhiệm vụ mới mà không cần fine-tuning.

- Chaining: Chuỗi hóa, kỹ thuật liên kết nhiều gợi ý hoặc nhiệm vụ tuần tự, trong đó kết quả của một gợi ý thông báo (làm đầu vào) cho gợi ý tiếp theo.

- Fine-Tuning: Tinh chỉnh, điều chỉnh LLM cho một nhiệm vụ hoặc lĩnh vực cụ thể bằng cách huấn luyện thêm trên dữ liệu đặc thù cho nhiệm vụ.

- PEFT (Parameter-Efficient Fine-Tuning): Tinh chỉnh hiệu quả tham số, chỉ cập nhật một số ít tham số của LLM, do đó hiệu quả về mặt tính toán và chi phí.

- Distillation: Chưng cất, quá trình huấn luyện một mô hình nhỏ hơn, hiệu quả hơn để bắt chước hành vi của một mô hình lớn hơn, phức tạp hơn.

- Quantization: Lượng tử hóa, giảm độ chính xác của các tham số mô hình để tiết kiệm tài nguyên tính toán mà không làm giảm hiệu suất.

- GGUF: Định dạng lưu trữ nhị phân được thiết kế để tải và lưu mô hình nhanh chóng, và dễ dàng đọc.

- Reinforcement Learning: Học tăng cường, huấn luyện mô hình thông qua thử nghiệm và sai sót, với phần thưởng/hình phạt dựa trên đầu ra được tạo ra.

- RLHF (Reinforcement Learning from Human Feedback): Học tăng cường từ phản hồi của con người, được sử dụng làm phần thưởng/hình phạt cho mô hình.

- Adversarial Attacks: Tấn công đối kháng, nỗ lực cố ý đánh lừa mô hình bằng các đầu vào được thiết kế cẩn thận, khiến chúng mắc lỗi.

- MoE (Mixture of Experts): Hỗn hợp chuyên gia, kiến trúc mô hình kết hợp nhiều chuyên gia để cải thiện hiệu suất thông qua các điểm mạnh bổ sung.

- Hallucination: Ảo giác, xu hướng của LLM đôi khi tạo ra thông tin không chính xác hoặc không có thực.

Đọc thêm:

Nguồn: Aishwarya Naresh Reganti

[{"displaySettingInfo":"[{\"isFullLayout\":false,\"layoutWidthRatio\":\"\",\"showBlogMetadata\":true,\"showAds\":true,\"showQuickNoticeBar\":true,\"includeSuggestedAndRelatedBlogs\":true,\"enableLazyLoad\":true,\"quoteStyle\":\"1\",\"bigHeadingFontStyle\":\"1\",\"postPictureFrameStyle\":\"1\",\"isFaqLayout\":false,\"isIncludedCaption\":false,\"faqLayoutTheme\":\"1\",\"isSliderLayout\":false}]"},{"articleSourceInfo":"[{\"sourceName\":\"\",\"sourceValue\":\"\"}]"},{"privacyInfo":"[{\"isOutsideVietnam\":false}]"},{"tocInfo":"[{\"isEnabledTOC\":true,\"isAutoNumbering\":false,\"isShowKeyHeadingWithIcon\":false}]"},{"termSettingInfo":"[{\"showTermsOnPage\":true,\"displaySequentialTermNumber\":true}]"}]

Nguồn

{content}

Link copied!

Link copied!

Mới cập nhật

Mới cập nhật